![]() 前沿资讯

1753339162更新

前沿资讯

1753339162更新

![]() 0

0

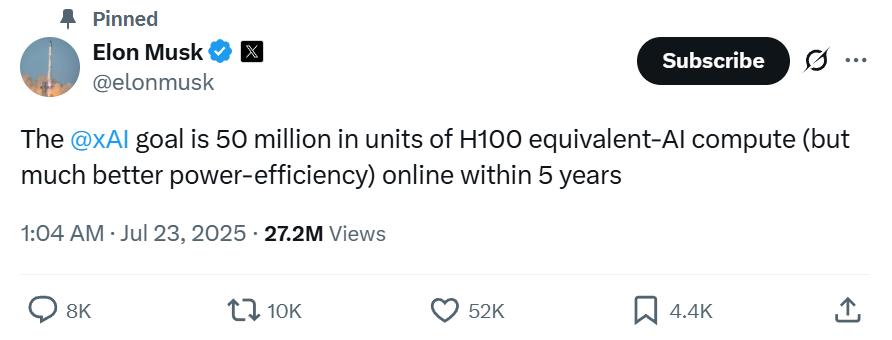

埃隆·马斯克在其社交平台宣布,旗下人工智能公司xAI将在未来五年内部署“相当于5000万颗NVIDIA H100”的AI算力,用于训练下一代大模型Grok。按FP16/BF16精度计算,该集群峰值性能将达50 ExaFLOPS。若计划如期落地,这将是全球迄今公开披露的最大规模AI训练集群。

马斯克透露,xAI目前已投入运营23万颗GPU,其中Colossus 1超算集群已上线20万颗Hopper架构的H100/H200,另有3万颗Blackwell架构GB200正在全力训练Grok。下一阶段,Colossus 2集群将再增55万颗GB200/GB300节点(单节点双GPU),首批节点预计数周内上线,最终GPU总量将突破100万颗。

NVIDIA近年来采用“架构-优化”双年节奏,Blackwell Ultra(B300系列)训练性能较初代Blackwell再提50%。按此速度,xAI有望在2029年仅用65万颗“Feynman Ultra”级GPU即可实现50 ExaFLOPS训练性能,比今日H100需求减少两个数量级。

若以H100功耗(700W)为基准,5000万颗GPU需35吉瓦电力,相当于35座核电站。即便未来芯片能效提升,50 ExaFLOPS集群仍需约4.7吉瓦,远超Colossus 2预估的1.4-1.96吉瓦。如何解决电力瓶颈,将成为马斯克下一步必须回答的问题。

就在昨日,OpenAI宣布将建设支持200万颗GPU的基础设施,而xAI此番直接把目标放大25倍,再次刷新AI竞赛天花板。全球数据中心供应链、能源配套、芯片产能都将面临前所未有的压力。

xAI方面未透露具体融资与合作伙伴细节,仅表示“资金充足”。业内人士分析,若马斯克能同步解决能源与芯片供应,xAI最快将在2028年率先实现50 ExaFLOPS训练算力,进一步拉开与竞争对手的差距。

参考资料:https://www.tomshardware.com/tech-industry/artificial-intelligence/elon-musk-says-xai-is-targeting-50-million-h100-equivalent-ai-gpus-in-five-years-230k-gpus-including-30k-gb200s-already-reportedly-operational-for-training-grok

豫公网安备41010702003375号

豫公网安备41010702003375号