![]() 工具推荐

1772443349更新

工具推荐

1772443349更新

![]() 1

1

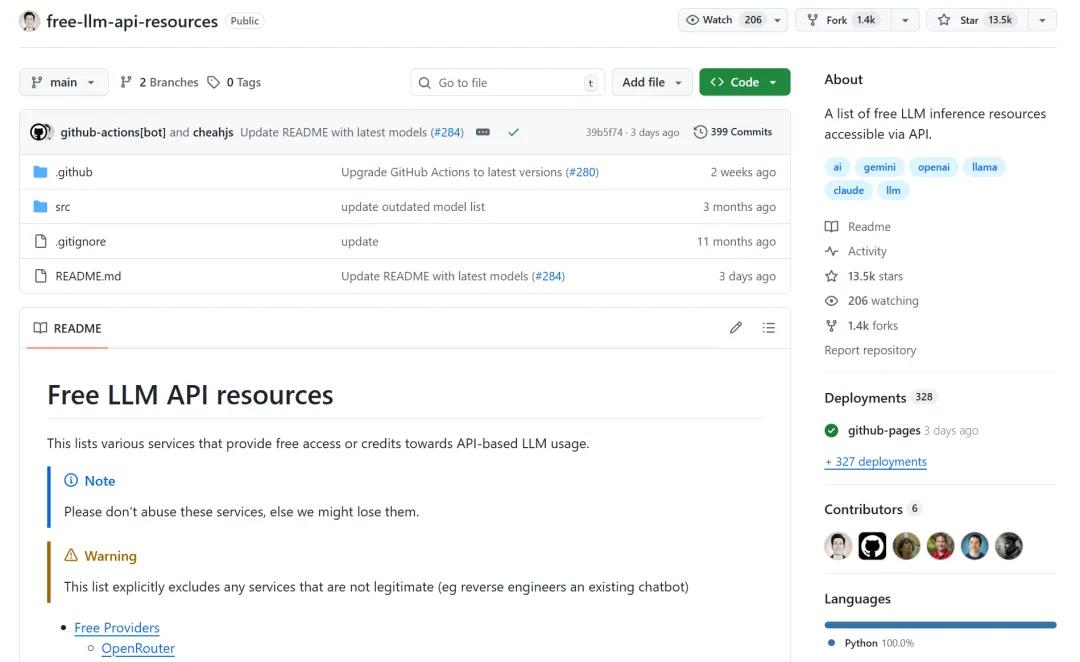

前两天在 GitHub 上看到一个项目。

简单粗暴,就一个 README。

但看完之后我直接好家伙。

它把全网能白嫖的 AI API 全部整理出来了。

26 个平台,100+ 免费模型,全部带详细额度限制和注册链接。

这个项目到底有多全?

先看目录:

免费提供商(13 个):

- OpenRouter

- Google AI Studio

- NVIDIA NIM

- Mistral

- HuggingFace

- Cerebras

- Groq

- Cohere

- GitHub Models

- Cloudflare Workers AI

- ...

提供试用积分的(13 个):

- Fireworks、Baseten、Nebius、Novita、Hyperbolic、SambaNova...

项目地址:

https://github.com/cheahjs/free-llm-api-resources

建议先收藏再往下看。

我亲测:这些才是真正够用的

我花了三天时间,一个一个试过来。

有些是坑,有些是真香。

接下来把压箱底的干货搬出来。

第一梯队:额度最宽松,必须知道

这几个平台,额度大到感人,普通人根本用不完。

- 1. Cerebras — 核弹级算力,白嫖界天花板

这家公司是做 AI 超算的,之前轰动业界的超大模型就是他们搞的。

现在开放了免费 API,额度离谱。

免费额度:

| 模型 | 每天请求 | 每天 tokens |

|---|---|---|

| 所有模型 | 14400 | 100,0000 |

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Qwen 3 235B | 额度大,参数最多,推理能力强 |

| Llama 3.3 70B | Meta 最新开源,性能稳定 |

| Qwen 3 32B | 中小场景首选,响应快 |

共 6 个模型可选择。

注册链接:

https://cloud.cerebras.ai

- 2. Groq — 速度最快的男人

Groq 这货最离谱的是速度。

之前用别的 API 等回复要好几秒,Groq 基本上秒回。推测是因为他们自研了 LPU 芯片。不管原理是什么总之一个字:快。

免费额度:

| 模型 | 每天请求 | 每分钟 tokens |

|---|---|---|

| Llama 3.1 8B | 1,4400 | 6000 |

| Llama 3.3 70B | 1000 | 1,2000 |

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Llama 4 Scout | 速度最快,30,000 tokens/分钟 |

| Llama 3.1 8B | 额度最大,日常首选 |

| kimi-k2-instruct | 国产模型,中文理解好 |

| qwen3-32b | 阿里千问,代码能力强 |

共 16 个模型 + 2 个语音模型。

注册链接:

https://console.groq.com

- 3. Cloudflare Workers AI — 隐藏 Boss

Cloudflare 的 AI 服务,知道的人不多,但额度需要注意。

免费额度: 每天 1,0000 neurons

注意:Cloudflare 使用 "neurons"(神经元)作为计算单位,而不是请求次数。一次典型对话(提示词+响应)大约消耗 100-500 neurons。

1,0000 neurons 实际上大约只能支持 20-100 次对话。

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Llama 3.3 70B | 主流大杯,性能稳定 |

| Mistral Small 3.1 | Mistral 最新,小而强 |

| Qwen QwQ 32B | 推理能力强 |

| Gemma 3 12B | Google 开源,小设备也能跑 |

共 56 个模型。

注册链接:

https://developers.cloudflare.com/workers-ai

- 4. Mistral(La Plateforme)— 开源大佬的诚意

Mistral 这家公司,之前 7B、8x7B 直接吊打闭源,把 AI 圈搅了个天翻地覆。

现在他们自己也搞了 API,关键是免费额度相当大方。

免费额度:

- 每月 10 亿 tokens

- 每分钟 50 万 tokens

注意:免费层需要选择加入数据训练。

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Mistral Small 3.1 | 最新版本,24B 参数性能强 |

| Codestral | 专门写代码,程序员必备 |

注册链接:

https://console.mistral.ai

第二梯队:额度够用,但有条件

这几个平台额度也不错,但有一些限制条件。

- 5. Google AI Studio — 谷歌豪横撒钱

免费额度:

| 模型 | 每分钟 tokens | 每天请求 |

|---|---|---|

| Gemini 2.5 Flash | 25,0000 | 20 次 |

| Gemma 3 27B | 1,5000 | 1,4400 次 |

注意:在英国/瑞士/EEA/EU 以外地区使用,数据会用于模型训练。

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Gemini 2.5 Flash | 额度大,多模态最强 |

| Gemma 3 27B | Google 最新开源,性能对标 GPT-4 |

| Gemma 3 12B | 小设备也能跑,灵活选择 |

共 7 个模型。

注册链接:

https://aistudio.google.com

- 6. OpenRouter — 聚合平台 yyds

这是目前最火的聚合平台,聚合了几十家 AI 服务。

推荐理由:

- 一个平台切换几十种模型

- 接口完全兼容 OpenAI,改个地址就能跑

免费额度:

- 20 次/分钟,50 次/天

注意:各模型共享配额。

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| Gemma 3 27B | Google 最新开源 |

| Mistral Small 3.1 | Mistral 最新小杯 |

| Step 3.5 Flash | 阶跃星辰国产之光 |

| Qwen 3 系列 | 阿里最新开源 |

共 30+ 个模型。

注册链接:

https://openrouter.ai

- 7. NVIDIA NIM — 亲儿子的诚意

这是 NVIDIA 亲儿子,推理能力最强。

注意: 需要手机号验证

免费额度:

- 40 次/分钟

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| nemotron-3-nano-30b | NVIDIA 自家模型 |

| Llama 系列 | 主流选择 |

| Mistral 系列 | 性能稳定 |

共 20+ 个模型。

注册链接:

https://build.nvidia.com

- 8. Cohere — 加拿大 AI 国家队

免费额度:

- 20 次/分钟,1,000 次/月

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| command-r-plus | 对话能力最强 |

| c4ai-aya-expanse | 多语言支持好 |

共 15+ 个模型。

注册链接:

https://cohere.com

第三梯队:有免费额度,但需要试用

这几个需要注册后手动领取,或者有试用期限。

- 9. Hyperbolic — $1 免费额度

推荐模型:

| 模型 | 推荐理由 |

|---|---|

| DeepSeek V3 0324 | 最新版本,性能接近 R1 |

| Llama 3.1 405B | 超大杯 |

| Qwen QwQ 32B | 推理能力强 |

共 20+ 个模型。

注册链接:

https://app.hyperbolic.xyz

- 10. Novita — $0.5 用一年

- 各种开源模型

- 注册就送 $0.5,有效期 1 年

注册链接:

https://novita.ai

- 11. SambaNova Cloud — $5 用三个月

推荐模型:

| 模型 |

|---|

| Llama 3.3 70B |

| DeepSeek-R1 |

| Qwen3 系列 |

共 15+ 个模型。

注册链接:

https://cloud.sambanova.ai

我是怎么用的?

说了这么多,我现在的用法是这样的:

| 场景 | 推荐平台 | 推荐模型 |

|---|---|---|

| 日常对话 | Groq | Llama 3.1 8B(额度大) |

| 强推理任务 | Cerebras | Qwen 3 235B |

| 写代码 | OpenRouter | qwen3-coder |

| 中文内容 | Groq | kimi-k2-instruct |

| 多模态 | Google AI Studio | Gemini 2.5 Flash |

NVIDIA NIM我也在用,白天使用Minimax的模型,响应还快速一些,也推荐尝试。

手把手起步方案

看完还不会用?

我给你一个最简单的起步方案:

第一步:注册 Cerebras(额度最大)

https://cloud.cerebras.ai

第二步:获取 API Key

第三步:复制下面代码

import openaiclient = openai.OpenAI( api_key="你刚才获取的 Key", base_url="https://api.cerebras.ai")response = client.chat.completions.create( model="qwen3-32b", messages=[{"role": "user", "content": "你好,请用 Python 写一个 Hello World"}])print(response.choices[0].message.content)第四步:运行

pip install openaipython demo.py完事儿。

写在最后

我为什么推荐这个项目?

因为它解决了信息差的问题。

很多人不知道有这些免费渠道,每个月白花冤枉钱。

这个 GitHub 项目帮我们整理好了全部资源,我们要做的只是去注册、去用。

我现在的原则是:能白嫖绝不花钱,能免费绝不付费。

收藏本文,下次做项目之前先来看看,别再傻傻交税了。

豫公网安备41010702003375号

豫公网安备41010702003375号