![]() 前沿资讯

1月前更新

前沿资讯

1月前更新

![]() 1

1

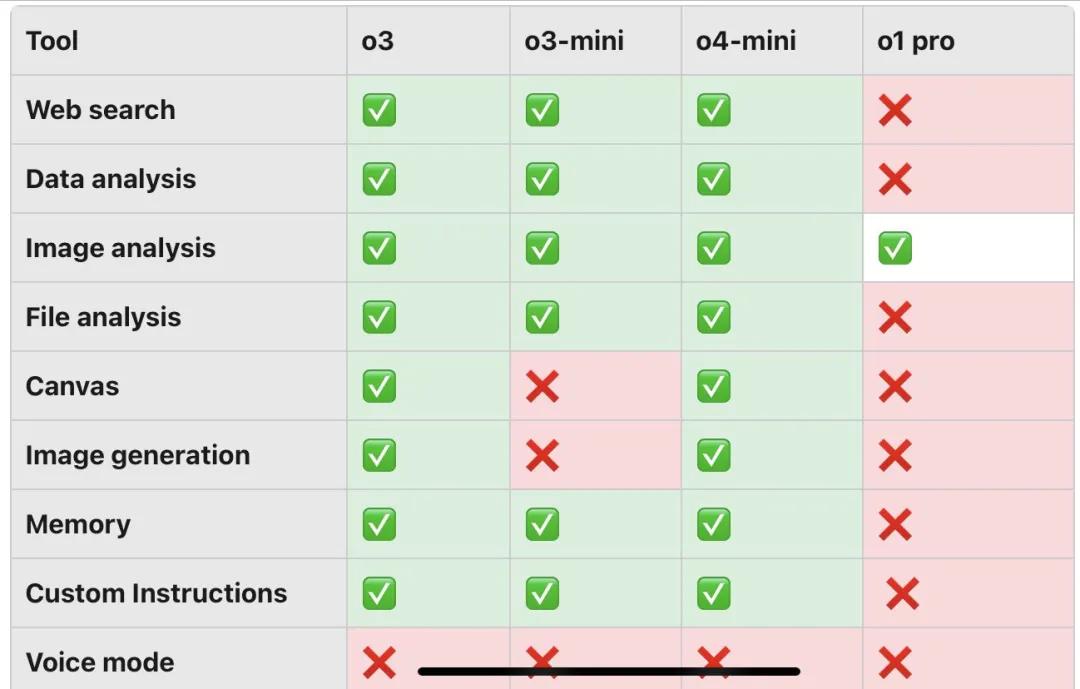

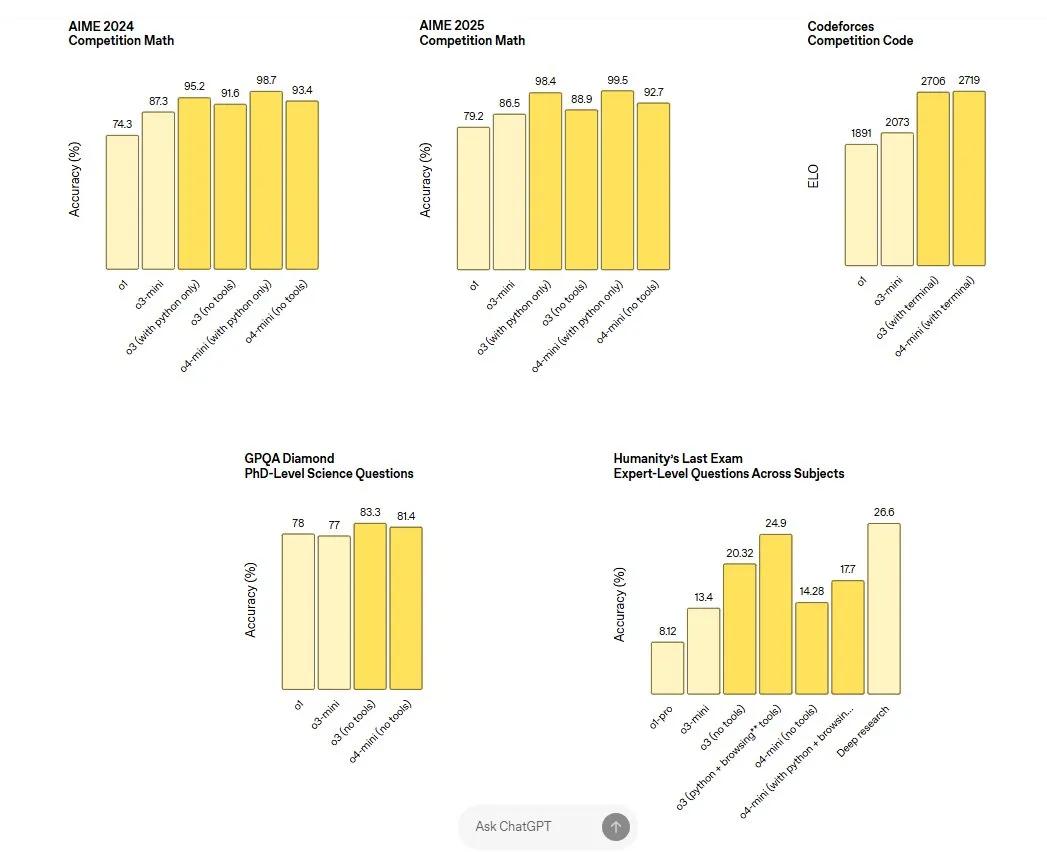

今天凌晨,OpenAI宣布推出两款全新推理模型o3和o4-mini。据OpenAI介绍,o3堪称其史上最先进推理模型,在数学、编码、推理、科学及视觉理解能力测试中,成绩远超以往模型。o4-mini则巧妙平衡价格、速度与性能,成为一个极具吸引力的选择。与旧版推理模型不同的是,o3和o4-mini可借助ChatGPT中的网页浏览、Python代码执行、图像处理及图像生成等工具生成回复。

OpenAI强调,o3和o4-mini是首批具备“图像思考”能力的模型。用户可上传白板草图、PDF图表等图像至ChatGPT,模型会在“思维链”阶段分析图像后作答。该能力可以让模型处理模糊、低质量图像,还能在推理时执行图像缩放、旋转等操作。此外,两款模型还能通过ChatGPT的Canvas功能在浏览器中运行Python代码,并在用户询问时事时进行网页搜索。

性能数据显示,o3在衡量编码能力的SWE-bench验证测试(无定制架构辅助)中表现卓越,得分高达69.1%。o4-mini同样表现出色,得分68.1%,远超OpenAI的o3-mini(49.3%),也优于Claude 3.7 Sonnet的62.3%。

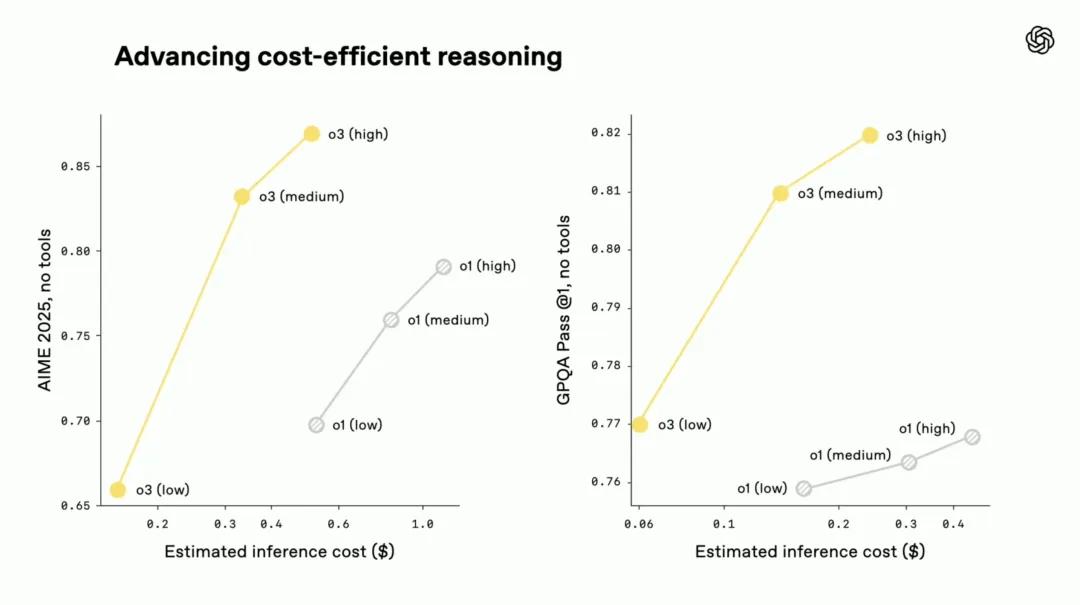

除ChatGPT外,o3、o4-mini和o4-mini-high三款模型还将通过OpenAI面向开发者的Chat Completions API和Responses API终端提供服务,工程师可按需付费,利用这些模型开发应用。在价格方面,鉴于o3性能提升,OpenAI定价还算亲民,输入每百万令牌收费10美元(约75万字),输出每百万令牌收费40美元。o4-mini收费标准与o3-mini一致,输入每百万令牌1.10美元,输出每百万令牌4.40美元。

在模型的使用方面,从发布日起,OpenAI的Pro、Plus和Team计划订阅用户将率先获得o3、o4-mini和o4-mini-high的使用权限,企业和教育用户需等待一周。OpenAI还将在未来几周内在API中发布这些模型,并支持工具使用功能。

有网友在测试之后,对o3的能力进行了总结,并称o3为“轻量级深度研究工具”。给它设定一项任务,然后过30秒或3分钟再来看,就能得到一个详尽的答案。它可以循环使用网页搜索、代码解释器、提醒功能和记忆等工具,这样一来,它可以编写复杂的功能代码,针对长篇文档回答棘手的研究问题,甚至还能为用户打造一门课程,并每天提醒用户去学习。

在测试中,o3始终比Anthropic的3.7 Sonnet和谷歌的Gemini 2.5 Pro速度更快,使用起来感觉很流畅。速度快。o3非常智能,给o3模型出了一些专家级别的数独难题,它一次就成功解出了,而Gemini 2.5 Pro和3.7 Sonnet都失败了。

它不像o1那样在社交互动方面表现生硬,也不像3.7 Sonnet那样刻意用力。它能理解用户的意图,并高质量地完成用户下达的指令。当让o3复一个漏洞时,它不会像Sonnet那样不管不顾地试图去做一些过于复杂的事。它也比其他o系列模型更有“氛围感”,和它交流更有趣,虽然它在写作方面不如GPT-4.5或Sonnet 3.5那么出色,但也很不错。

值得一提的是,o3险些与ChatGPT失之交臂。今年2月,OpenAI首席执行官萨姆·奥特曼曾暗示将资源投向融合o3技术的复杂替代方案。然而,DeepSeek、谷歌、Meta、xAI、Anthropic等竞争对手迅速跟进,推出性能相当甚至超越OpenAI的o1产品。紧接着,推理模型成为各AI实验室提升系统性能的核心发力点。最终在竞争压力下,OpenAI改变计划,决定推出o3。

OpenAI还透露,未来几周将推出o3-pro,该版本将利用更多计算资源生成答案,仅面向ChatGPT Pro订阅用户。萨姆·奥特曼指出,在GPT-5推出前,o3和o4-mini可能是ChatGPT中最后两款独立AI推理模型,而GPT-5将整合传统模型与推理模型。

参考资料:https://openai.com/index/thinking-with-images/

https://openai.com/index/introducing-o3-and-o4-mini/

https://x.com/aidan_mclau/status/1912580976456474812

豫公网安备41010702003375号

豫公网安备41010702003375号