![]() 前沿资讯

1768469254更新

前沿资讯

1768469254更新

![]() 0

0

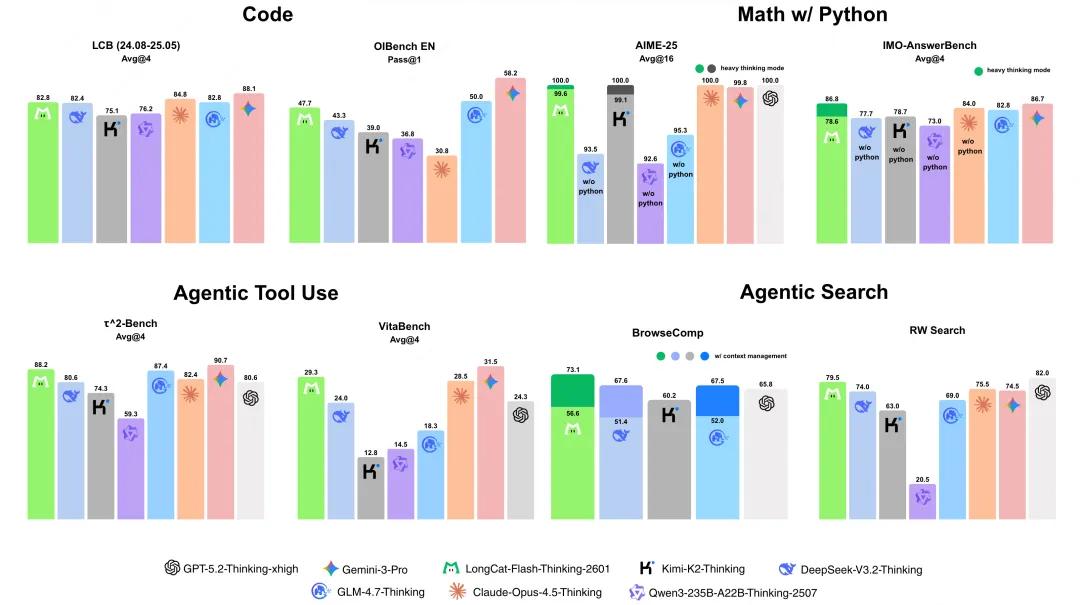

【导读】美团发布LongCat-Flash-Thinking-2601,这是一款专为深度和通用代理思维打造的强力大型推理模型。基于创新的混合专家(MoE)架构,该模型拥有5600亿总参数,在代理工具使用、代理搜索和工具集成推理等基准测试中均取得顶级表现。

美团正式推出LongCat-Flash-Thinking-2601,这是一款专为深度和通用代理思维设计的强力大型推理模型(LRM)。模型基于创新的混合专家(MoE)架构,拥有5600亿总参数和270亿激活参数,不仅在传统推理基准测试中保持竞争力,更通过精心设计的流水线,实现了代理能力的全面突破。

核心技术突破方面,开发团队构建了多样化的高质量环境作为强化学习的训练场,每个环境包含超过60个工具并以密集依赖图形式组织。扩展后的强化学习基础设施DORA支持大规模多环境训练,多环境任务以平衡方式组织并根据复杂度分配不同预算,使模型能够学习到可迁移的代理技能。

针对现实世界的鲁棒性挑战,LongCat-Flash-Thinking-2601明确将环境不完美性纳入训练过程。开发团队系统分析了代理场景中现实世界噪声的主要来源,设计自动化管道注入训练噪声,并采用课程策略逐步增加噪声类型和强度。这种渐进式策略使模型发展出强大韧性,在不完美条件下保持稳定性能,在Vita-Noise和Tau²-Noise基准测试中表现优异。

Heavy Thinking模式是另一项重要创新,将复杂问题分解为并行思考和总结两个互补阶段。在推理宽度扩展方面,模型并行生成多条独立推理轨迹,实现广泛探索。在推理深度扩展方面,精炼轨迹可递归反馈形成迭代推理循环,支持渐进式深层推理。专门设计的强化学习阶段进一步释放了这一模式的潜力。

性能表现方面,该模型在多项权威测试中展现顶级竞争力。在AIME-25数学推理中达到99.6/100.0,在代理搜索BrowseComp中达到73.1,在代理工具使用τ²-Avg中达到88.2,在随机复杂任务中达到35.8。特别是在复杂随机任务中,LongCat-Flash-Thinking-2601的表现超越了Claude Opus 4.5等业界顶级模型,充分证明了其卓越的泛化能力。

接下来,开发团队宣布百万token上下文的Zigzag Attention技术即将推出。目前模型已在https://longcat.ai/开放试用,API访问同步开放。

项目地址:

Hugging Face:

https://huggingface.co/meituan-longcat/LongCat-Flash-Thinking-2601

GitHub:

https://github.com/meituan-longcat/LongCat-Flash-Thinking-2601

参考资料:https://x.com/Meituan_LongCat/status/2011515214521647603

豫公网安备41010702003375号

豫公网安备41010702003375号