![]() 前沿资讯

1771238349更新

前沿资讯

1771238349更新

![]() 65

65

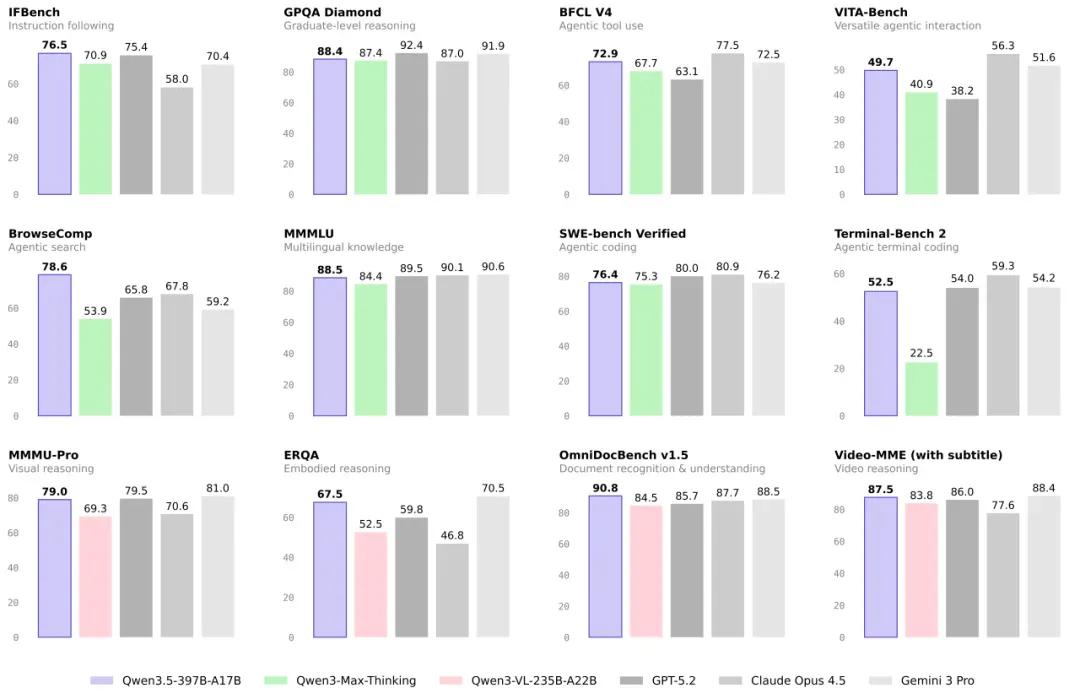

概要:阿里云正式发布Qwen3.5,作为原生视觉-语言模型,Qwen3.5-397B-A17B采用了线性注意力与稀疏混合专家(MoE)相结合的混合架构。在参数规模上,该模型总参数量达3970亿,每次前向传播激活170亿参数。根据官方数据,在32k/256k上下文长度下,解码吞吐量分别达到Qwen3-Max的8.6倍和19倍。目前,用户可通过chat.qwen.ai和阿里云百炼平台体验该模型。

阿里云正式发布Qwen3.5,并推出Qwen3.5系列的首款模型Qwen3.5-397B-A17B的开放权重版本。根据官方介绍,作为原生视觉-语言模型,该模型在推理、编程、智能体能力与多模态理解等基准评估中表现不俗。

Qwen3.5采用了混合架构设计,将线性注意力(Gated Delta Networks)与稀疏混合专家(MoE)相结合。这一架构的主要特点包括:

- 总参数量:3970亿

- 每次前向激活参数:170亿

官方表示,这种设计旨在平衡能力与推理效率。

根据阿里云发布的技术信息,Qwen3.5在以下三个维度有所突破:

能力维度: 官方声称Qwen3.5-397B-A17B与参数量超过1T的Qwen3-Max-Base表现相当。

效率维度: 基于Qwen3-Next架构,在32k/256k上下文长度下:

- 解码吞吐量分别是Qwen3-Max的8.6倍/19.0倍

- 解码吞吐量分别是Qwen3-235B-A22B的3.5倍/7.2倍

通用性维度:

- 多语言覆盖从119种增至201种语言/方言

- 词表规模从15万扩展至25万,官方称在多数语言上带来约10%-60%的编码/解码效率提升

阿里云表示,通过可扩展的异步强化学习框架,实现了3×-5×的端到端加速。

具备Agent能力的Qwen3.5支持结合多模态进行思考、搜索和工具调用,主要应用场景包括:

代码智能体:

- 网页开发:可协助进行网页构建和用户界面设计

- OpenClaw集成:支持编程任务、网页搜索和信息收集

- Qwen Code:支持自然语言指令转化为代码

视觉智能体:

- GUI智能体:支持操作手机与电脑完成日常任务

- 视觉编程:上下文窗口扩展至1M tokens,可处理最长2小时的视频

- 带图推理:支持图像的裁剪、标注等处理

- 空间智能:支持物体计数、空间关系描述等任务

- 视觉推理:支持学科解题等视觉推理任务

体验渠道:

Qwen Chat:https://chat.qwen.ai/

阿里云百炼:用户可通过阿里云百炼调用Qwen3.5-Plus模型。开启高级功能可通过设置以下参数:

- enable_thinking:开启推理模式

- enable_search:开启联网搜索与Code Interpreter

Qwen3.5为通用数字智能体提供了新的技术基础。阿里云表示,下一阶段将重点关注跨会话持久记忆、具身接口、自我改进机制等方向,探索智能体的长期自主运行能力。

参考资料:https://mp.weixin.qq.com/s/AAanKh5uiCuvFVMAP4nIvw

豫公网安备41010702003375号

豫公网安备41010702003375号