![]() 前沿资讯

1776939566更新

前沿资讯

1776939566更新

![]() 2

2

阿里云于4月22日晚间,正式开源Qwen3.6-27B模型,这是一款拥有270亿参数的稠密多模态模型,在智能体编程基准测试中全面超越了前代开源旗舰Qwen3.5-397B-A17B(总参数397B/激活参数17B的MoE模型),引发业界广泛关注。

Qwen3.6-27B最为引人注目之处在于其"身材"虽小,但"码力"惊人。

作为一款稠密架构模型,它无需MoE路由即可部署,在实际编程任务中的表现却全面超越了参数规模高达15倍的MoE旗舰模型。

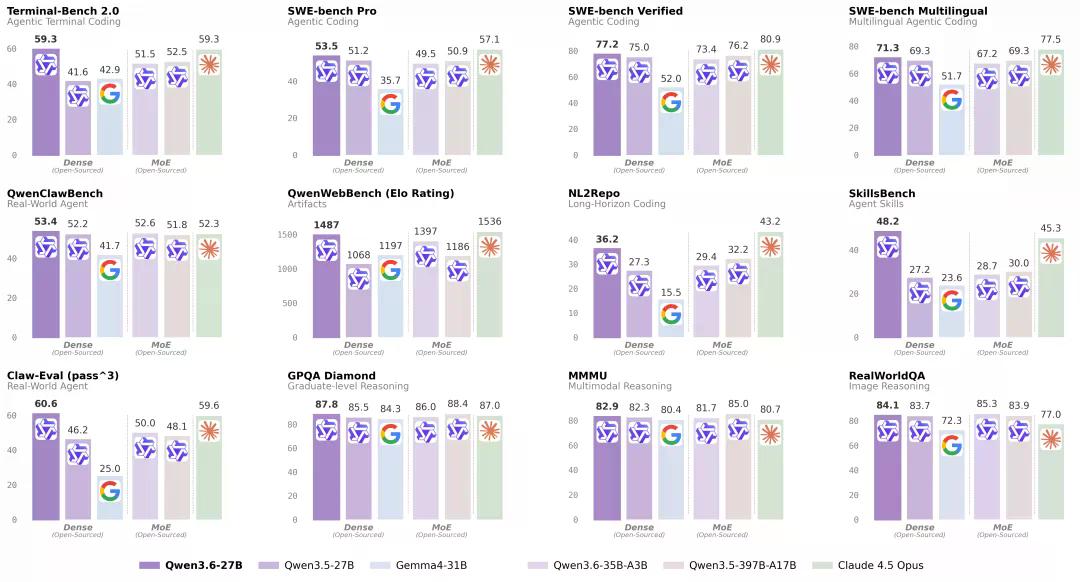

在智能体编程核心基准测试中,Qwen3.6-27B全面超越前代旗舰:在Terminal-Bench 2.0(智能体编程任务)中得分59.3,领先Qwen3.5-397B-A17B(52.5)达6.8分;在SWE-bench Verified(软件工程任务)中得分77.2,超越Qwen3.5-397B-A17B(76.2)1分;在SkillsBench(智能体技能评估)中得分48.2,大幅领先Qwen3.5-397B-A17B(30.0)60%。

与当前业界最强的闭源模型Claude 4.5 Opus相比,Qwen3.6-27B在多个关键指标上实现超越:

在研究生级推理GPQA Diamond上,Qwen3.6-27B得分87.8,略高于Claude 4.5 Opus的87.0;在智能体技能评估SkillsBench上,Qwen3.6-27B得分48.2,超越Claude 4.5 Opus的45.3;在真实世界代理任务QwenClawBench上,Qwen3.6-27B得分53.4,领先Claude 4.5 Opus的52.3;在智能体编程任务Terminal-Bench 2.0上,两者并列第一(59.3)。

当然,在部分编程基准上Claude 4.5 Opus仍具优势:SWE-bench Verified得分80.9,领先Qwen3.6-27B的77.2;SWE-bench Pro得分57.1,领先Qwen3.6-27B的53.5。

Qwen3.6-27B原生支持多模态思考与非思考模式,能够处理图像、视频与文本的多模态理解。在视频理解任务VideoMME上,Qwen3.6-27B得分87.7,超越Qwen3.5-397B-A17B(87.5),在所有参测模型中位居首位。在视觉智能体任务AndroidWorld上,Qwen3.6-27B得分70.3,同样领跑所有模型。在文档理解、空间智能等任务上,Qwen3.6-27B也处于领先水平。

目前,Qwen3.6-27B的开源权重已在Hugging Face和ModelScope平台上线,支持本地部署。开发者还可以在Qwen Studio(chat.qwen.ai)上进行交互体验。阿里云百炼平台的API支持也即将上线,将支持在消息中保留思维内容的"preserve_thinking"功能,推荐用于智能体任务。

此外,该模型可无缝集成到OpenClaw、Claude Code和Qwen Code等主流编程助手中,为开发者提供高效且具备上下文感知能力的编码体验。

阿里云方面表示,Qwen3.6-27B的发布证明了一个经过精心训练的稠密模型,可以在开发者最关心的任务上超越规模显著更大的前代模型。270亿参数这一规模,也被视作开源模型中"广泛部署"的理想规格——既具备足够的智能水平,又便于部署和服务。

随着Qwen3.6-27B的开源,Qwen3.6系列已完整发布——从30亿激活参数的Qwen3.6-35B-A3B,到线上的Qwen3.6-Plus和Qwen3.6-Max-Preview,这一代模型在各个规模上都实现了智能体编程能力的飞跃。

豫公网安备41010702003375号

豫公网安备41010702003375号